La inteligencia artificial está transformando la forma en que las empresas investigan, analizan información y toman decisiones. Hoy, muchas organizaciones integran soluciones basadas en inteligencia artificial para mejorar su productividad y optimizar procesos.

Sin embargo, a medida que crece el uso de herramientas como ChatGPT, también aumenta una preocupación clave: cómo garantizar la seguridad y la privacidad de los datos que se comparten con estas plataformas.

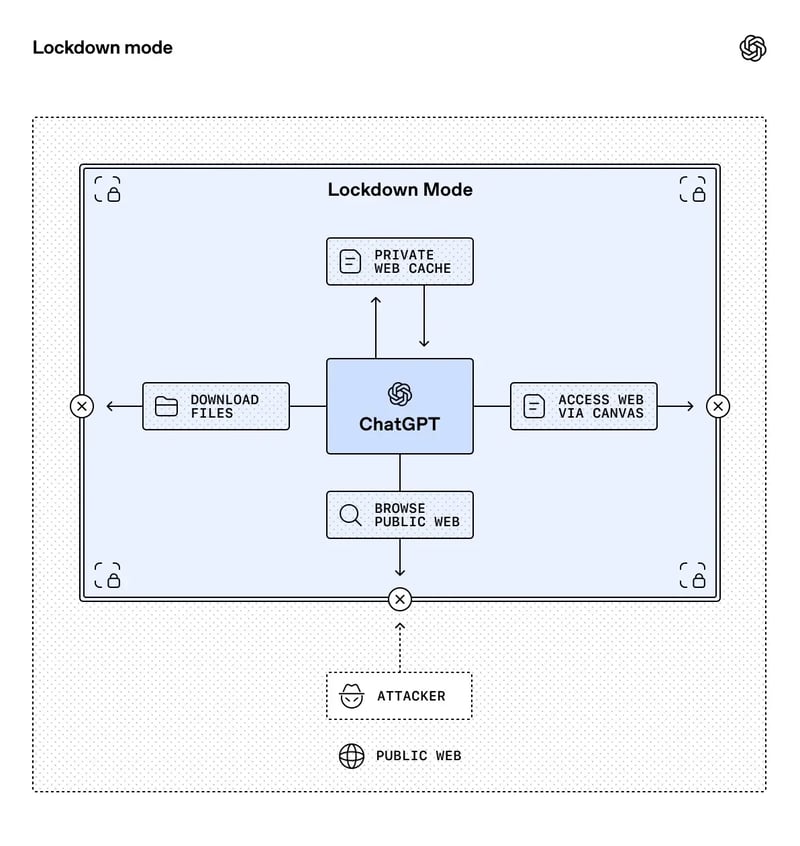

Para responder a este desafío, OpenAI ha introducido el Lockdown Mode, una función diseñada para reforzar la seguridad en ChatGPT cuando se trabaja con información sensible o en entornos de alto riesgo.

En este artículo veremos qué es el Lockdown Mode, cómo funciona y qué cambia en el uso de ChatGPT cuando se activa, especialmente en contextos profesionales donde la protección de datos es prioritaria.

¿Qué es el Lockdown Mode de ChatGPT y quién debería activarlo?

El Lockdown Mode es una configuración de seguridad avanzada diseñada para entornos donde el riesgo de exposición de datos es especialmente alto. Su función principal es restringir ciertas capacidades de la plataforma para minimizar posibles vulnerabilidades.

Aunque herramientas como ChatGPT ya incorporan múltiples medidas de seguridad, este modo añade una capa adicional de protección orientada a perfiles profesionales que trabajan con información crítica.

Entre los perfiles que más pueden beneficiarse de este sistema destacan:

- Equipos directivos que manejan información estratégica.

- Departamentos legales o financieros con datos confidenciales.

- Empresas tecnológicas o startups con propiedad intelectual sensible.

- Organizaciones que trabajan con datos personales o sanitarios.

En estos contextos, el Lockdown Mode actúa como un modo de seguridad reforzado, similar a lo que ocurre con algunos sistemas operativos o navegadores que ofrecen modos de protección avanzada.

El objetivo no es impedir el uso de la IA, sino reducir las funcionalidades que podrían aumentar el riesgo de exposición de información.

Los 3 pilares del blindaje en el Modo de Bloqueo

El Lockdown Mode se basa en tres mecanismos principales que refuerzan la seguridad digital en entornos de IA.

Navegación limitada a contenido en caché para evitar exfiltración

Uno de los principales riesgos en plataformas de IA generativa es la posibilidad de que una herramienta acceda a recursos externos o interactúe con contenido que pueda generar fugas de información. Por ello, el Lockdown Mode limita el acceso a navegación externa, permitiendo únicamente el uso de contenido previamente almacenado en caché.

Esta medida reduce significativamente el riesgo de:

- Exposición accidental de datos.

- Interacciones con páginas maliciosas.

- Filtración de información corporativa.

En entornos empresariales donde se trabaja con documentación estratégica o datos confidenciales, esta limitación puede marcar la diferencia entre un uso seguro o un riesgo innecesario.

Desactivación de herramientas de alto riesgo: adiós al Agent Mode

Otro de los pilares del Lockdown Mode es la desactivación de funciones avanzadas que implican mayor autonomía del sistema. En entornos normales, algunas herramientas de IA pueden:

- Automatizar tareas complejas.

- Acceder a diferentes servicios.

- Ejecutar acciones en múltiples sistemas.

Sin embargo, estas capacidades también amplían la superficie de riesgo. Por eso, el modo de bloqueo desactiva funciones consideradas sensibles, como ciertos modos de agente o automatización avanzada.

Esto implica que el sistema opera de forma más controlada y predecible, priorizando la seguridad frente a la automatización total.

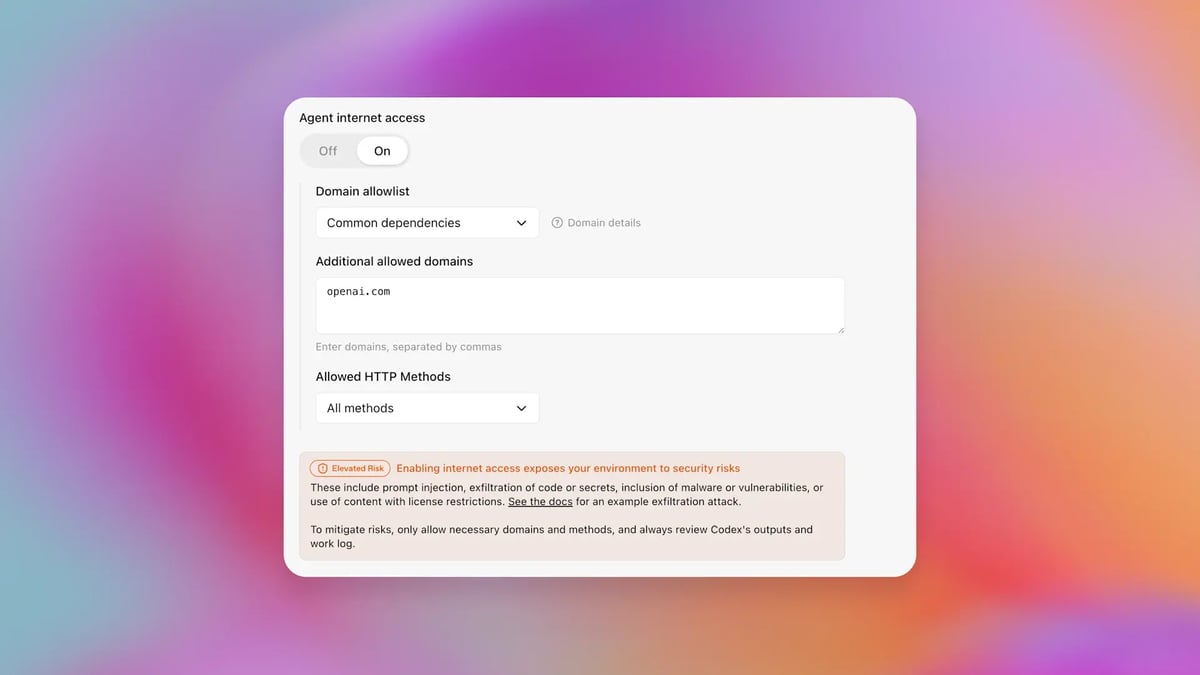

Etiquetas de "Riesgo Elevado": identificación proactiva de funciones vulnerables

Una de las novedades más interesantes del Lockdown Mode es la introducción de etiquetas de riesgo. Estas etiquetas sirven para identificar funciones o herramientas que podrían implicar un mayor nivel de exposición de datos. En la práctica, esto permite:

- Alertar al usuario antes de usar una función sensible.

- Facilitar decisiones informadas sobre seguridad.

- Mejorar la transparencia en el uso de herramientas de IA.

Este enfoque es especialmente relevante en empresas que utilizan múltiples plataformas de IA o diferentes herramientas de IA dentro de sus flujos de trabajo.

Por ejemplo, cuando se integran varias soluciones en un mismo proceso, contar con señales claras de riesgo ayuda a mantener un control más sólido sobre la seguridad del ecosistema digital. Puedes ver ejemplos de este tipo de soluciones en recopilaciones de

herramientas de IA.

Fuente: openai.com

Cómo configurar el Lockdown Mode en entornos corporativos

El Lockdown Mode está pensado especialmente para organizaciones que utilizan ChatGPT en contextos profesionales donde se manejan datos sensibles. Su implementación es especialmente relevante en entornos corporativos que buscan aprovechar el potencial de la IA generativa sin comprometer la seguridad de la información.

Implementación en ChatGPT Enterprise, Edu y Health

Las versiones empresariales de la plataforma están diseñadas para ofrecer mayor control sobre el uso de la inteligencia artificial dentro de la organización. En estos entornos, el Lockdown Mode puede activarse como una configuración adicional que restringe determinadas funciones del sistema.

El objetivo es crear un entorno de trabajo más controlado. Al reducir el acceso a herramientas o capacidades que puedan aumentar el riesgo de filtración de datos, las empresas pueden utilizar plataformas de IA con mayor tranquilidad.

Esta opción resulta especialmente útil en sectores donde la protección de datos es crítica, como el financiero, el sanitario o el tecnológico. En estos casos, la configuración del Lockdown Mode permite mantener el uso de ChatGPT como herramienta de apoyo, pero bajo un marco de seguridad más estricto.

Gestión de permisos para ejecutivos y equipos con datos sensibles

Otro aspecto importante del Lockdown Mode es la gestión de permisos dentro de la organización. No todos los usuarios necesitan el mismo nivel de acceso a las funciones de una herramienta de IA.

Por ejemplo, los equipos que trabajan con información estratégica o confidencial pueden utilizar el sistema con las restricciones activadas, mientras que otros departamentos pueden operar con configuraciones más abiertas.

Este enfoque permite mantener un equilibrio entre productividad y seguridad. Los directivos y responsables de marketing pueden seguir utilizando herramientas de IA para analizar información o generar ideas, pero con mecanismos que reducen el riesgo de exposición de datos sensibles.

Fuente: openai.com

Seguridad vs. Funcionalidad: ¿qué sacrificamos al activar el bloqueo?

El Lockdown Mode introduce una cuestión clave en el uso de la IA generativa en entornos empresariales: el equilibrio entre seguridad y funcionalidad.

El impacto en la velocidad de investigación y el uso de herramientas de IA avanzadas

Cuando se activa el modo de bloqueo, algunas de las funciones más avanzadas del sistema quedan limitadas o desactivadas. Esto puede afectar a la velocidad con la que los usuarios investigan información, automatizan tareas o utilizan determinadas capacidades de la plataforma.

En un contexto de marketing o estrategia digital, donde la rapidez en la investigación y la generación de contenido es importante, estas restricciones pueden suponer un pequeño freno operativo. Sin embargo, el objetivo no es limitar la productividad, sino reducir posibles vulnerabilidades en el uso de la tecnología.

Para muchas organizaciones, esta limitación es un compromiso razonable si se tiene en cuenta el valor de los datos que manejan.

Por qué la protección de datos debe prevalecer sobre la automatización total

La expansión de las herramientas de IA ha llevado a muchas empresas a automatizar procesos cada vez más complejos. Pero a medida que aumenta el nivel de automatización, también crece la superficie de riesgo en términos de seguridad digital. El Lockdown Mode parte de una idea clara: no todo debe automatizarse si ello compromete la protección de los datos.

En entornos corporativos donde se manejan estrategias de negocio, información de clientes o datos financieros, la prioridad debe ser siempre la seguridad. Desde esta perspectiva, limitar ciertas funciones puede ser una decisión estratégica que proteja el valor de la información a largo plazo.

El futuro de la seguridad en IA generativa

La aparición de funciones como el Lockdown Mode refleja un cambio importante en la evolución de la tecnología de IA. Durante los primeros años del desarrollo de estas herramientas, el foco estaba principalmente en ampliar sus capacidades. Hoy, el debate también gira en torno a cómo garantizar un uso seguro de la IA.

A medida que más empresas adoptan soluciones basadas en IA generativa, la seguridad se convierte en un elemento central del diseño de estas plataformas. No se trata solo de ofrecer funcionalidades avanzadas, sino de integrar mecanismos que permitan utilizarlas de forma responsable.

En este contexto, es probable que veamos cada vez más sistemas que ofrezcan niveles de protección adaptables según el perfil del usuario o el tipo de información que se maneja.

Las organizaciones que integren estas tecnologías en su estrategia deberán aprender a gestionar este equilibrio. El reto no será únicamente aprovechar el potencial de la inteligencia artificial, sino hacerlo con criterios sólidos de privacidad digital y protección de datos.

Conclusión

El Lockdown Mode de ChatGPT es una respuesta directa a una necesidad creciente: utilizar la inteligencia artificial en entornos profesionales sin poner en riesgo la información sensible. Aunque implica algunas limitaciones en el uso de ciertas funciones, su objetivo es claro: reforzar la seguridad digital cuando el contexto lo requiere.

Para directivos y responsables de marketing que utilizan ChatGPT o cualquier otra solución basada en IA generativa, este tipo de configuraciones representa un paso hacia un uso más responsable de la tecnología. No se trata de frenar la innovación, sino de garantizar que el crecimiento de las plataformas de IA vaya acompañado de mecanismos adecuados de protección.

En definitiva, el futuro de la inteligencia artificial en las empresas no dependerá solo de lo que estas herramientas puedan hacer, sino también de cómo se gestionan los riesgos asociados a su uso.

AI-Driven Business Digital Strategy Consultant en Cyberclick. Experta en ecommerce, experiencia de usuario (UX), inbound marketing y estrategias de CRO orientadas a maximizar las conversiones. Acompaña a las empresas en la integración de la IA en su negocio y en la toma de decisiones digitales para impulsar crecimiento y eficiencia.

AI-Driven Business Digital Strategy Consultant at Cyberclick. Expert in ecommerce, user experience (UX), inbound marketing and CRO strategies focused on maximising conversions. She helps companies integrate AI into their business and make better digital decisions to drive growth and efficiency.

Deja tu comentario y únete a la conversación